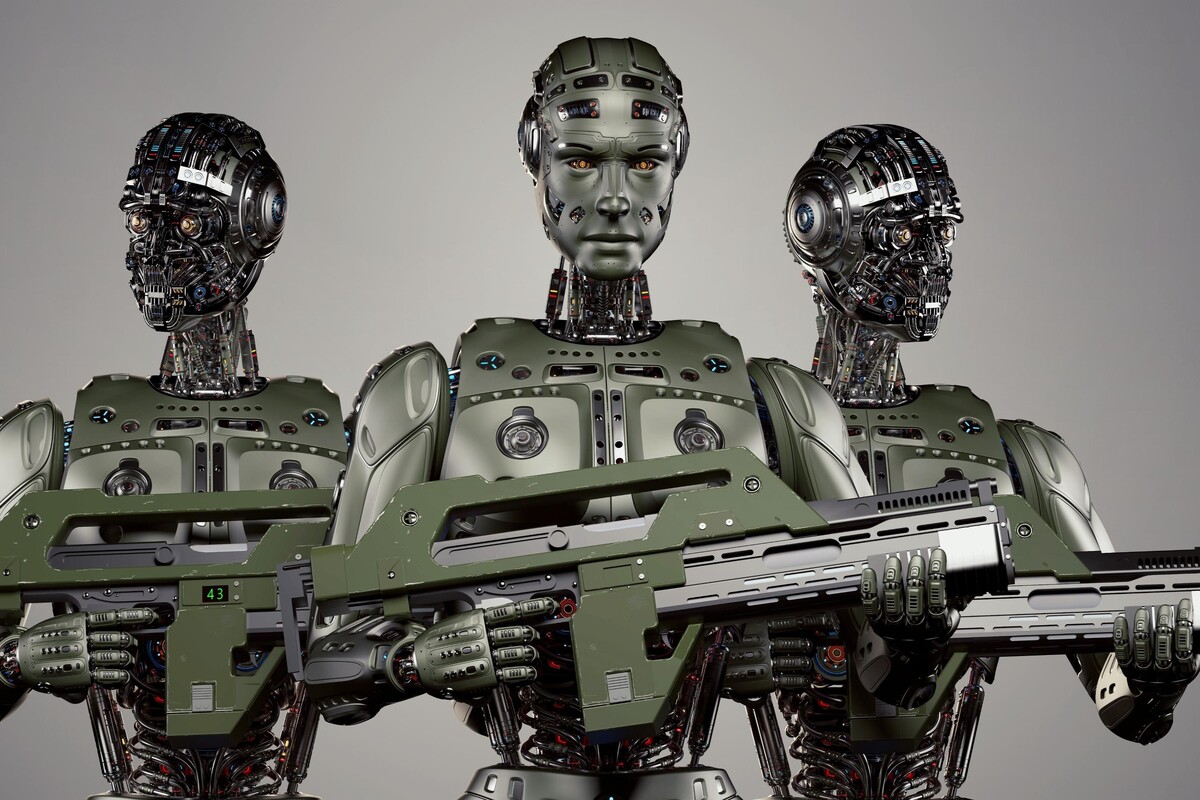

وقتی الگوریتمها تصمیم به کشتن میگیرند

به گزارش خبرگزاری آنا؛ در میانه درگیریهای نظامی میان ایران و رژیم صهیونیستی، یک تحول پنهان، اما بیسابقه در حال وقوع است: استفاده از هوش مصنوعی بهعنوان فرمانده میدان نبرد. از شناسایی اهداف گرفته تا انتخاب نوع حمله، بسیاری از تصمیمات حیاتی حالا به عهده ماشینها گذاشته شده است؛ ماشینهایی که نه احساس دارند، نه ترس، و نه اخلاق.

در هفتههای اخیر، تحلیلهایی منتشر شده که نشان میدهد رژیم صهیونیستی از سیستمهای مبتنی بر هوش مصنوعی برای شناسایی اهداف در غزه و حتی ایران استفاده کرده است. یکی از معروفترین این سامانهها، Fire Factory نام دارد؛ سامانهای که بهصورت خودکار، بر اساس دادههای ماهوارهای، اطلاعات جاسوسی و موقعیت مکانی، لیست هدفها را آماده و اولویتبندی میکند. طبق اطلاعات فاششده، این سامانه در عرض چند ثانیه میتواند تصمیم بگیرد که کدام ساختمان، خودرو یا حتی فرد، هدف حمله باشد.

اما ایران هم در این میدان تنها نمانده است. با بهرهگیری از متخصصان داخلی، پژوهشگران دفاعی کشور سامانههایی طراحی کردهاند که با استفاده از یادگیری ماشین و تحلیل تصاویر پهپادی، قادر به رهگیری و قفلکردن روی اهداف متحرک حتی در شب یا شرایط سخت جوی هستند. پهپادهای هوشمند سپاه، با کمک الگوریتمهای تشخیص چهره و حرکات، میتوانند بهصورت مستقل عملیات انجام دهند، بدون نیاز به کنترل لحظهبهلحظه انسان.

در عین حال، فضای سایبری نیز میدان بازی هوش مصنوعی شده است. رباتهای خودکار تولید محتوا، تحلیلگرهای رفتاری برای کشف الگوهای نفوذ دشمن، و حتی سامانههای ضدنفوذ که میتوانند حملات پیچیده را در کمتر از چند ثانیه شناسایی و خنثی کنند، بخشی از توان دیجیتال ایران در این حوزه است.

اما این فناوری خارقالعاده، با تهدیدی جدی نیز همراه است: اخلاق در جنگهای مبتنی بر هوش مصنوعی. اگر یک پهپاد اشتباهی مرتکب شود چه کسی پاسخگو خواهد بود؟ اگر یک الگوریتم، بر اساس دادهای ناقص، تصمیم به حمله بگیرد چه؟ آیا زمان آن نرسیده که برای هوش مصنوعی در جنگ، قوانینی جهانی وضع شود؟

گزارش سازمان ملل در سال ۲۰۲۳ هشدار داد که رباتهای قاتل بدون انسان در حلقه تصمیمگیری، تهدیدی بزرگ برای امنیت جهانیاند. با این حال، کشورهایی مانند آمریکا، رژیم صهیونیستی، چین و حتی فرانسه، میلیاردها دلار روی توسعه این فناوریها سرمایهگذاری کردهاند.

نکته جالب آنکه، بسیاری از این الگوریتمها ابتدا برای کارهای غیرنظامی توسعه یافتهاند؛ مثلاً تحلیلگرهای ویدئویی که برای کنترل ترافیک شهری طراحی شده بودند، اکنون به ابزار شناسایی تحرکات نظامی تبدیل شدهاند. مرز بین صلح و جنگ، در دنیای هوش مصنوعی، بسیار باریکتر از آن چیزیست که تصور میکنیم.

در نهایت باید گفت که جنگ امروز، نه فقط با گلوله و آتش، بلکه با کد، دیتا و هوش مصنوعی پیش میرود؛ و شاید خطرناکترین سلاح قرن بیستویکم، نه یک موشک اتمی، بلکه خطی از کدهای بیصدا باشد که سرنوشت انسانها را در میدان نبرد رقم میزند.

انتهای پیام/